Универсальный чат-бот отвечает из своего обучающего набора. Izlūks AI отвечает из сегодняшнего реестра и показывает строку, из которой пришёл ответ.

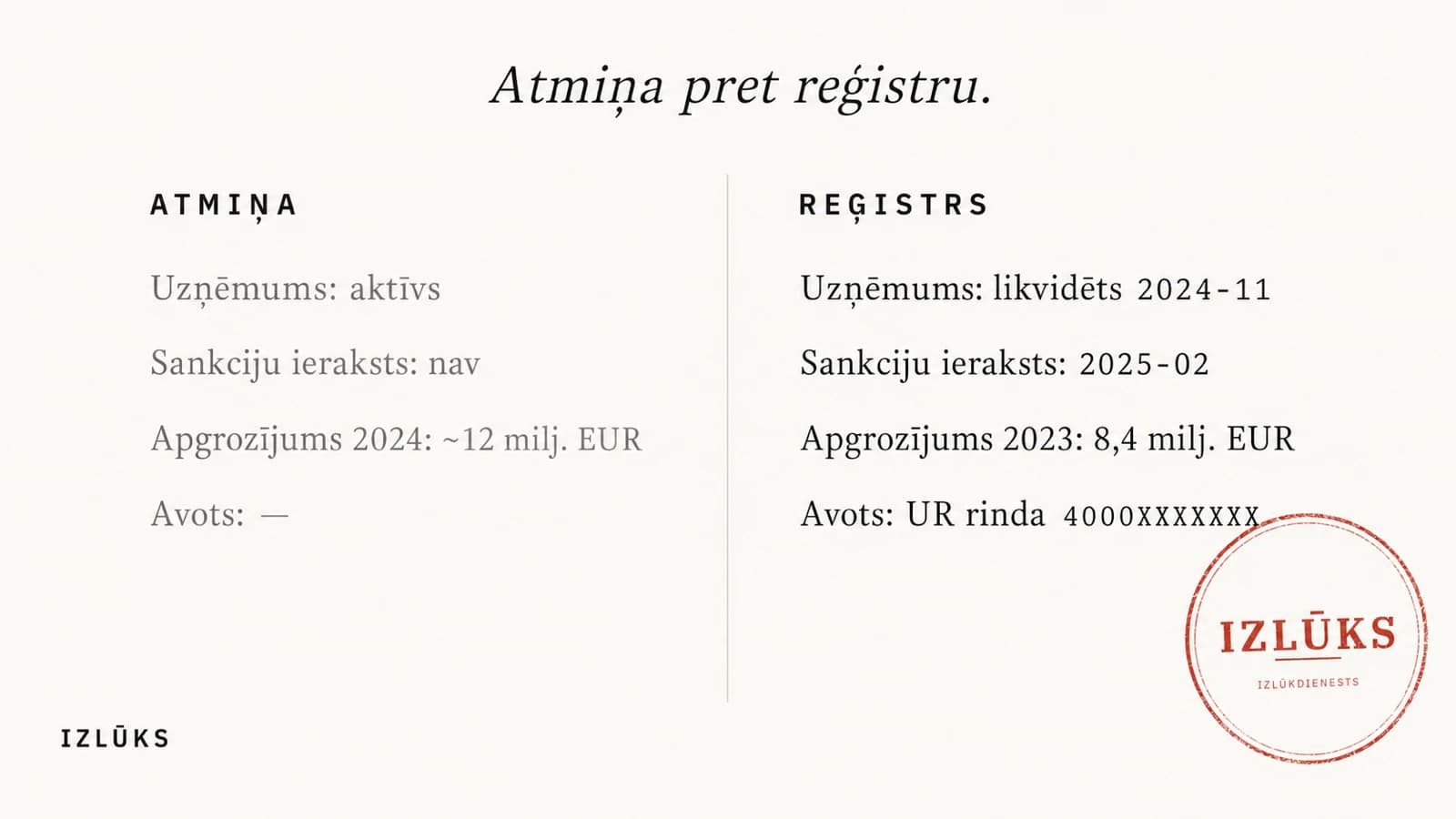

ChatGPT уверенно подтверждает: латвийский поставщик активен и в санкционных списках не значится. Предприятие ликвидировано в ноябре 2024 года. Санкционная запись добавлена в феврале 2025-го.

Ответ звучит точно. В аудите он не годится.

Почему два ответа расходятся?

Большие языковые модели отвечают на основе данных, на которых их обучили. Обучение закрывается на определённой дате и больше не продолжается. Эту дату называют моментом обрыва обучения. У крупных публично доступных моделей она сейчас отстоит от сегодняшнего дня на три–восемнадцать месяцев. За это время латвийский реестр предприятий принимает тысячи новых и обновлённых записей. Всё, что попало туда после обрыва, модели не видно: новые SIA, ликвидированные SIA, поданные годовые отчёты, обновлённые санкционные пакеты.

Вторая проблема — структурная. Модель не знает того, чего не знает. Когда вопрос касается конкретной латвийской SIA, которой не было в обучающем наборе, модель генерирует ответ из того, что звучит правдоподобно. Цифра попадает в правильный порядок величины; название — в правильную форму. На профессиональном языке это называют галлюцинацией; для аудитора такой ответ не пригоден.

Izlūks AI устроен иначе. Он обращается не к памяти модели, а к латвийскому реестру предприятий напрямую. Ответ приходит из строки, существующей в базе данных сейчас, вместе с регкодом, датой и — если вопрос потребовал SQL — самим запросом. Если данных нет, AI так и говорит. Правдоподобных цифр он не сочиняет.

Для комплаенс-аналитика и аудит-партнёра ответ — не результат работы. Доказуемый ответ — да. Разница кажется незначительной, пока никто не спросил про источник. У универсального чат-бота источника нет. Izlūks AI показывает его построчно.

Понедельничный утренний вопрос можно задать обоим. Только у одного ответ выдерживает сверку с сегодняшним реестром.