Vispārējais AI asistents atbild no apmācību kopas. Izlūks AI atbild no šodienas reģistra un uzrāda ierakstu, kas atbildi pamato.

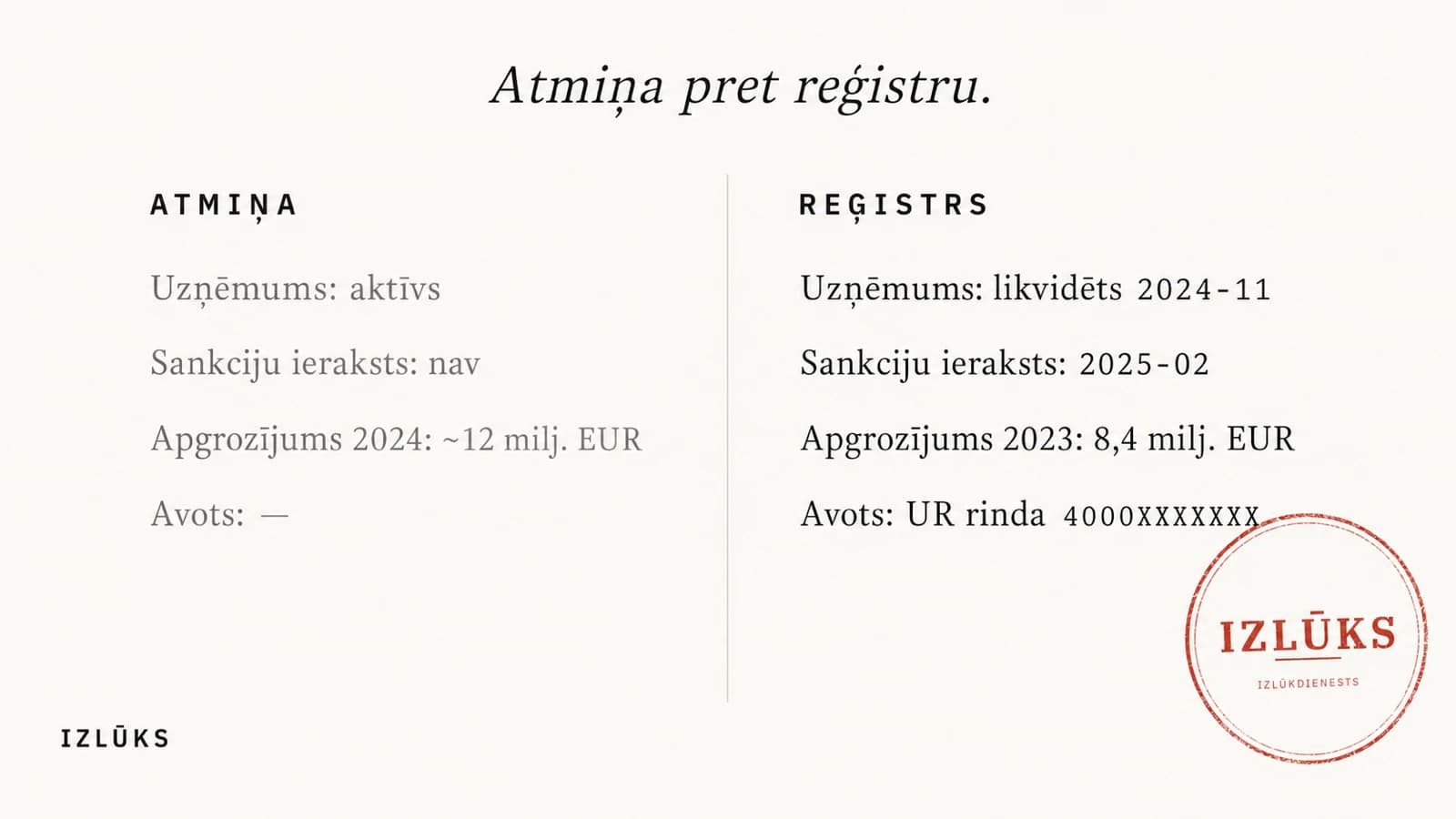

ChatGPT pārliecinoši apstiprina, ka Latvijas piegādātājs aktīvi darbojas un sankciju sarakstos nav. Uzņēmums likvidēts 2024. gada novembrī. Sankciju ieraksts pievienots 2025. gada februārī.

Atbilde izklausās precīza. Auditā tā tāda nav.

Kāpēc abas atbildes atšķiras?

Ģeneratīvie AI modeļi atbild no datiem, ar kuriem tos apmācīja. Apmācība tiek noslēgta vienā datumā un pēc tam vairs neturpinās. Šo datumu sauc par apmācību griešanas brīdi. Lielākajiem publiski pieejamajiem modeļiem tas pašlaik atpaliek no šodienas par trim līdz astoņpadsmit mēnešiem. Latvijā šajā laikā Uzņēmumu reģistrs pieņem tūkstošiem jaunu un atjauninātu ierakstu. Viss, kas tur nokļuva pēc griešanas datuma, modelim nav redzams: jaunas SIA, slēgtas SIA, iesniegti gada pārskati, atjauninātas sankciju paketes.

Otra problēma ir strukturāla. Modelis nezina, ko tas nezina. Kad jautājums skar konkrētu Latvijas SIA un apmācību kopā tās datu nav, modelis ģenerē atbildi no tā, kas izklausās ticams. Skaitlis nāk pareizajā lieluma kārtā, vārds — pareizajā formā. Šo parādību sauc par halucināciju; auditoram tāda atbilde ir nederīga.

Izlūks AI strādā citādi. Tas nevaicā modeļa atmiņai; tas vaicā Latvijas uzņēmumu reģistram tieši. Atbilde nāk no rindas, kas šobrīd eksistē datu bāzē, kopā ar regkodu, datumu un — ja jautājums prasīja SQL — pašu vaicājumu. Ja datu nav, AI to saka. Skaitļus, kas izklausās ticami, tas neģenerē.

Komplianses analītiķim un audita partnerim atbilde pati par sevi vēl nav rezultāts. Rezultāts ir atbilde, kuru var pamatot. Atšķirība šķiet niecīga, kamēr neviens nejautā pēc avota. Vispārējam AI asistentam tāda avota nav. Izlūks AI to uzrāda ierakstu pa ierakstam.

Pirmdienas rīta jautājumu var uzdot abiem. Tikai vienam no tiem atbilde stāv pretī šodienas reģistram.